CASTELLÓ. Salir a dar un paseo es, para la mayoría de la población, una actividad carente de emoción más allá de la belleza del paisaje, en su caso. Sin embargo, para una persona invidente la misma actividad puede representar un verdadero desafío para sus sentidos, hasta el punto de poner en riesgo su integridad física. Desde hace muchas generaciones, un perro guía y un bastón son los acompañantes habituales de mujeres y hombres que padecen ceguera en sus distintos grados. Ahora, después de ocho años de investigación y trabajo duro, una startup castellonense promete cambiar este paradigma. Eyesynth, empresa alojada en el vivero de CEEI Castellón, ha lanzado al mercado unas gafas inteligentes que suponen una verdadera disrupción innovadora al aportar seguridad e independencia para la población invidente.

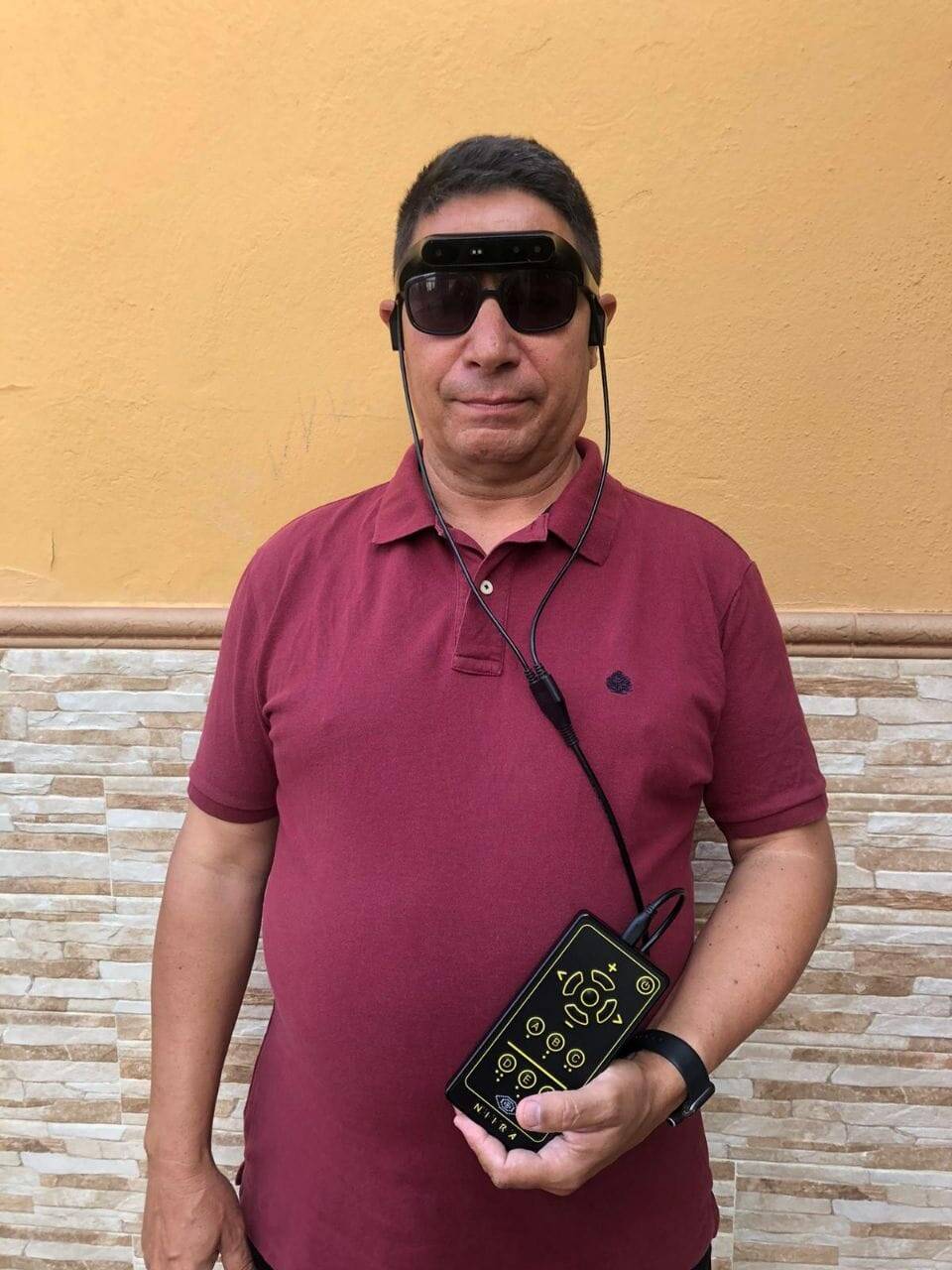

Las gafas tienen marca propia -NIIRA, siglas de Non Invasive Image Reconstruction into Audio- y permiten a sus usuarios “tener una consciencia de todo alrededor sin que nadie tenga que decirte nada”. Y es que en la naturaleza de nuestra actividad cerebral reside una de las premisas sobre las que se ha asentado su desarrollo, según explica el CEO de Eyesynth, Antonio Quesada: “el cerebro es especialista en dar sentido a todo”. El sistema se basa en un procesado instantáneo de las imágenes en alta precisión -detectando objetos desde 1 mm de altura- que son convertidas en señales auditivas en tiempo real, que se envían al cerebro a través del nervio coclear, mediante el cráneo (lo que libera el tímpano para el resto de sonidos del ambiente y evita el estrés auditivo). Capaz de funcionar en la oscuridad, su batería permite hasta 10 horas de funcionamiento continuo. Y la guinda: el instrumento tiene potencia para nuevas aplicaciones y funciones que se irán incorporando por software al equipo de cada usuario a través de su WiFi.

El usuario puede elegir entre dos opciones: el modo rastreo -que analiza lo que tiene frente a sí- y el modo panorámico -que detecta los objetos a ambos lados, con un rango de hasta cinco metros. La persona invidente aprende paulatinamente el lenguaje visual de NIIRA y afina su percepción con el uso hasta extremos llamativos. “Un usuario -explica Quesada- nos contaba hace poco que había sido capaz de detectar incluso que su madre se había cortado el pelo”. En la vida cotidiana de los exteriores, la seguridad se traduce en la posibilidad de detectar a tiempo ramas, salientes de paredes… en definitiva, posibles fuentes de accidentes antes difícilmente evitables con el uso del bastón y el perro guía. Las personas ciegas pueden comprobar así cómo de lejos tienen un objeto y a qué altura se aproxima.

El proceso

¿Cómo fue la gestación de NIIRA? Todo empezó con una conversación y el recordatorio de un pequeño superpoder que tiene una parte de la población. La primera la tuvo Quesada con un amigo, padre de un niño invidente de nacimiento, compañero de colegio de su hija. “Hablábamos mucho de tecnología y de sus aplicaciones a la vida cotidiana, y en el caso de los ciegos la charla siempre terminaba en frustración, porque desde el bastón y el perro guía, no hay un estándar, no hay soluciones aceptadas por el mercado”. Pero a esa desazón se le uniría la memoria de ese superpoder, clave para el “momento eureka”, según recuerda Quesada. Se trata de la sinestesia, que según la RAE es la “imagen o sensación subjetiva, propia de un sentido, determinada por otra sensación que afecta a un sentido diferente”. Este cruce de los sentidos humanos hace que un bebé pueda “oler” los colores o “saborear” los sonidos. Todo está inicialmente mezclado, pero solo hasta que el cerebro aprende a descartar combinaciones, porque no las necesita, y así se adapta al medio. El 20% de la población adulta mantiene una leve sinestesia, y en el caso de Quesada, tiene tintes musicales: “cada timbre me supone una forma geométrica”. Reflexionando sobre ello, en 2014 “pensé en qué pasaría si invertía el proceso, si tomaba una forma geométrica y trataba de traducirlo a sonidos”.

Así fue cómo, hace nueve años, Eyesynth empezó a tomar forma. Por entonces, Quesada participaba en Dembeta, otra empresa dedicada a los desarrollos de 3D en tiempo real: “hacíamos simulación y Realidad Virtual unos años antes de que se popularizase el término”. En aquel contexto nacieron las primeras pruebas, el embrión de NIIRA: “hicimos pruebas con el hijo de mi amigo y el niño iba como un tiro, acertando todas las formas geométricas”. Superada la emoción del momento, confiesa Quesada, “llegó la hora de hacer a Google la pregunta del terror: si alguien ya lo había hecho antes”.

Con alivio, comprobaron que no existía ningún desarrollo tecnológico de este tipo. Las interfaces que existían se dirigían al oído y daban pistas al usuario sobre el tipo de objeto que era (una silla, una taza), informaciones accesorias al margen de lo fundamental: proporcionar seguridad y autonomía al usuario. Ello animó a los creadores de Eyesynth a pensar en un método universal, que permitiera a los ciegos guiarse al margen del idioma, transmitiendo la información esencial mediante la combinación de sonidos graves y agudos con intensidad modulada por distancia y volúmenes de los objetos. “Empezamos con los medios de Dembeta, y los socios hicimos un movimiento kamikaze, metiendo todos los recursos a este proyecto”.

Ese fue el punto de partida de una larga y azarosa travesía, que comenzó con el desarrollo de proyectos de software. Cuando empezó a requerir nuevas inyecciones económicas, se recurrió a una primera ronda con las famosas 3F (family, friends and fools). Más tarde, la incorporación de una family office inversora permitió a Eyesynth realizar su primer prototipo de hardware. “Era grande, pesadote, casi te cortaba la nariz por el peso, pero funcionaba”. Con él, en 2016, a Eyesynth se le abrieron las puertas del escaparate televisivo nacional a través de El Hormiguero de Pablo Motos. Aun con el foco mediático, los gastos se disparaban notablemente por la parte del hardware, con un desarrollo muy exigente a nivel económico. Acudió entonces la Unión Europea al rescate en format de una ayuda de Horizonte 2020, que permitió miniaturizar la tecnología y hacerla más aplicable. Corría 2017 y se interponía un importante obstáculo: “la ayuda europea te permitía desarrollar todo el producto, pero no producirlo”. Fue entonces cuando llegó, en palabras de Quesada, “un inversor danés caído del cielo que nos dio el espaldarazo definitivo”. En Christen H. Nielsen, CEO de Ortofon en Dinamarca, se reunían varias condiciones extraordinarias: tenía experiencia en producción electrónica de artículos de alta gama y un amplio bagaje como mentor a sus espaldas, además del factor de aportación de capital. “Su conocimiento ha sido fundamental para entrar en un mercado totalmente nuevo, y además ha visto clara la vocación social, la idea de que la tecnología deber servir a la gente, ser humanista”.

Así ha crecido NIIRA, con una clara premisa de diseño: “queremos adaptar el invididuo al medio porque es lo más realista, no hacerlo al revés”. Por el camino, Quesada dice haber aprendido que la sociedad “tiende a etiquetar” y que perder la vista es un trance muy duro “pero es el principio de otra cosa: me reconforta pensar que sigues adelante y puedes ser plenamente feliz: la vida te enseña que hay gente con ojos perfectos que no ve nada y ciegos que ven perfectamente”. En el desarrollo del producto, “una pesadilla a nivel técnico y financiero”, todo queda compensado “cuando viene la gente, prueba NIIRA y se emociona: ese retorno es impagable”, confiesa el CEO de Eyesynth, quien explica que antes de la pandemia, cada jueves ofrecían una jornada de puertas abiertas. “Y venía gente de medio mundo, incluso desde Colombia, para probarlo durante una hora y luego volverse a su casa”. Más de 150 pruebas en vivo reafirmaron a sus creadores de la necesidad de esta tecnología a nivel mundial, y les mostró las peculiaridades culturales: “en este país, una persona ciega tiene oportunidades para ganarse la vida, pero en otros, la ceguera te hace un ser inferior, y se está malgastando talento de gente fantástica arrinconada por un prejuicio social”

Con un equipo de 15 personas con puntales como Julián Santiago, CTO y arquitecto de software, Eyesynth ha conseguido todo un hito desde Castelló. De un gran procesador a otro que no necesita ni ventiladores y con gran autonomía; de dispositivos que se sobrecalentaban a otro que se mantiene fresco, los desafíos han sido múltiples y severos hasta llegar a un aparato que los usuarios pueden llevar en su bolso e hibernarlo a voluntad. Por no hablar del crecimiento exponencial de los costes de los componentes electrónicos. Eso sí: “hilar fino pide trabajo de la persona invidente, que debe ser paciente para aprender a aprovechar el dispositivo al máximo: la recompensa es que evolucionas y percibes cada vez más detalles”. Su precio, 2.987€, IVA incluido, ha visto ajustados los márgenes de la empresa “para llegar al mayor número de personas”, si bien de momento solo está disponible en España, en pequeños lotes de 50 unidades, pero con un cualificado servicio postventa, gracias al cual las sugerencias de los usuarios son incorporadas paulatinamente a las nuevas versiones del software. Se ofrece un mes de prueba, al cabo del cual, el cliente puede pedir la devolución íntegra del dinero, si no queda convencido. “Vamos a introducir nuevas funcionalidades, mejorar la ergonomía, reconocimiento facial, introducir la detección del color… tenemos mucha ilusión y muchas peticiones desde fuera de España”.

Usuarios satisfechos

Por el momento, las óptimas expectativas vienen alimentadas por las opiniones de los usuarios que han probado tanto los primeros prototipos como el producto ya comercializado. Así, el valenciano Domingo Bonet, de Enguera, subraya la gran evolución experimentada por NIIRA: “hablo casi todas las semanas con Antonio para apuntar detallitos, sobre todo ideas de software, y todo lo que vamos diciendo lo incorporan”. Con 56 años, diagnostica de retinosis a los 20 y ciego total desde hace los 43, Domingo ha conocido diferentes proyectos de investigación universitaria y hospitalaria hasta llegar al desarrollo de Eyesynth. “El diseño ha mejorado mucho desde el primero que conocí, al que llamábamos Frankestein, muy aparatoso, hasta el actual diseño impreso en 3D, con acabados cada vez mejores”. En cuanto a su usabilidad, destaca que le aporta independencia: “no vas al fin del mundo, y yo me sigo orientando por la calle por el viento, el sol, por ruidos… pero cada día vas aprendiendo una cosa nueva y lo utilizas para lo que quieres, desde escanear la mesa hasta para pasear, y eso es lo fundamental”. Hace poco “me atreví a hacer un recorrido rural que hago habitualmente sin la perra, y con el bastón no me hubiera atrevido”.

Por su parte, el vendedor de la ONCE Sergio Fernández asegura desde Cuenca que lleva desde octubre testeando las gafas “y cuanto más las usas, más entiendes su lenguaje, que tiene muchos matices de sonido”. Entre sus últimas sugerencias, la idea de incorporar el reconocimiento facial o la posibilidad de grabar un recorrido que se realice con frecuencia. Su primera vez con un prototipo de la startup castellonense fue en 2018, y destaca que ahora “es mucho más cómodo”. Pero sobre todas sus cualidades, antepone la seguridad: “cuando voy a mi punto de venta, detecta el toldo del bar que hay al lado, y me permite orientarme muy bien para llegar a mi espacio”. Según Fernández, “no es complicado, hay que tener paciencia y practicar, pero te mejora la calidad de vida, especialmente con el modo panorámico por la calle, que modulándolo es una pasada”.